11 Mon

TIL

[AI 스쿨 1기] 6주차 DAY 1

가우시안 분포(Gaussian Distribution)

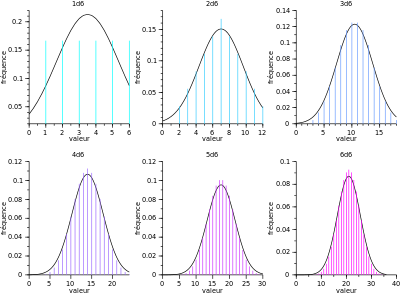

가우시안 분포가 일어나는 여러가지 상황

정보이론에서 엔트로피를 최대화시키는 확률분포

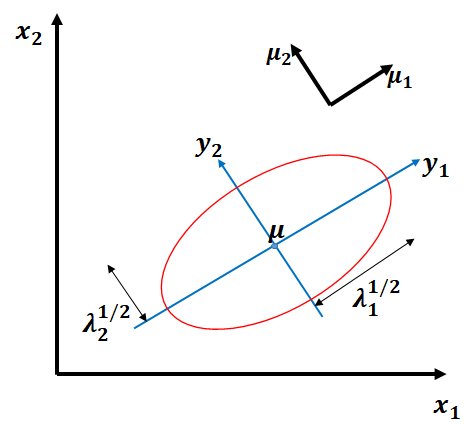

가우시안 분포의 기하학적인 형태

가우시안 분포의 기댓값

조건부 가우시안 분포(Conditional Gaussian Distribution)

주변 가우시안 분포(Marginal Gaussian Distributions)

가우시안 분포를 위한 베이즈 정리(Bayes' Theorem for Gaussian Variables)

가우시안 분포의 최대우도(Maximum Likelihood for the Gaussian)

가우시안 분포를 위한 베이지안 추론(Bayesian Inference for the Gaussian)

Last updated